Google は最近、複数のアップグレードや新モデルを含む、Gemini AI モデルの一連のアップデートを発表しました。その中でも注目を集めたのは、ビデオと音声の機能を備えたマルチモーダル AI モデルである Gemini Live です。

2 月に Bard が Gemini に改名されて以来、この AI モデルは Android デバイス上の Google アシスタントの代わりとして機能してきました。ただし、現時点ではできることはかなり限られています。Google は Gemini Live で、より強力で多用途な AI モデルを提供することで、この状況を変えようとしています。

Gemini Liveとは何ですか?

Google は、ユーザーに改善された AI エクスペリエンスを提供し、OpenAI の GPT-4o 強化 ChatGPT に対抗するために、先日の I/O 開発者会議で Gemini Live を発表しました。Gemini Live により、ユーザーは音声、そして後にはビデオを通じて、リアルタイムで自然でパーソナライズされた会話をすることができます。

この新しい AI モデルは Google の Project Astra の一部です。これは、日常生活からのさまざまな入力を使用して支援を提供できる汎用 AI アシスタントを構築するという、検索大手の取り組みです。たとえば、Gemini Live はテキスト、スマートフォンのカメラからの映像、および音声を使用して質問に答えることができます。

Google によると、この新しい自然言語モデルは、ユーザーが問題を解決したり、さまざまなアクションを実行したりするのに役立つだけでなく、対話中に完全に自然に感じられるようになります。ユーザーは、携帯電話の音声アイコンをタップして Gemini Live を起動することができ、音声波形効果とともに AI が全画面で表示されます。

その後、実際のパーソナル アシスタントと同じように AI と会話できます。アップグレードされた AI モデルがどのように役立つかを示す優れた例として、面接の準備を手伝ってほしいと頼んだ場合が挙げられます。Gemini Live は、強調できるスキルを提案したり、人前で話すためのヒントなどを提供してくれます。

特徴

Gemini Live には、Google アシスタント、Apple の Siri、Amazon の Alexa よりもはるかに優れた AI アシスタントとなる機能がいくつか搭載されています。

双方向音声会話

Gemini Live では、会話をすることができ、人間のような言葉による応答が得られるため、魅力的で直感的な会話が実現します。たとえば、天気について質問すると、正確で簡潔な最新情報が返ってきます。

スマートアシスタント機能

AI モデルはスマート アシスタントとして機能し、電子メールからの情報の要約やカレンダーの更新などのタスクを実行できます。たとえば、コンサートのチラシの写真を撮れば、Gemini がそのイベントをカレンダーに追加します。

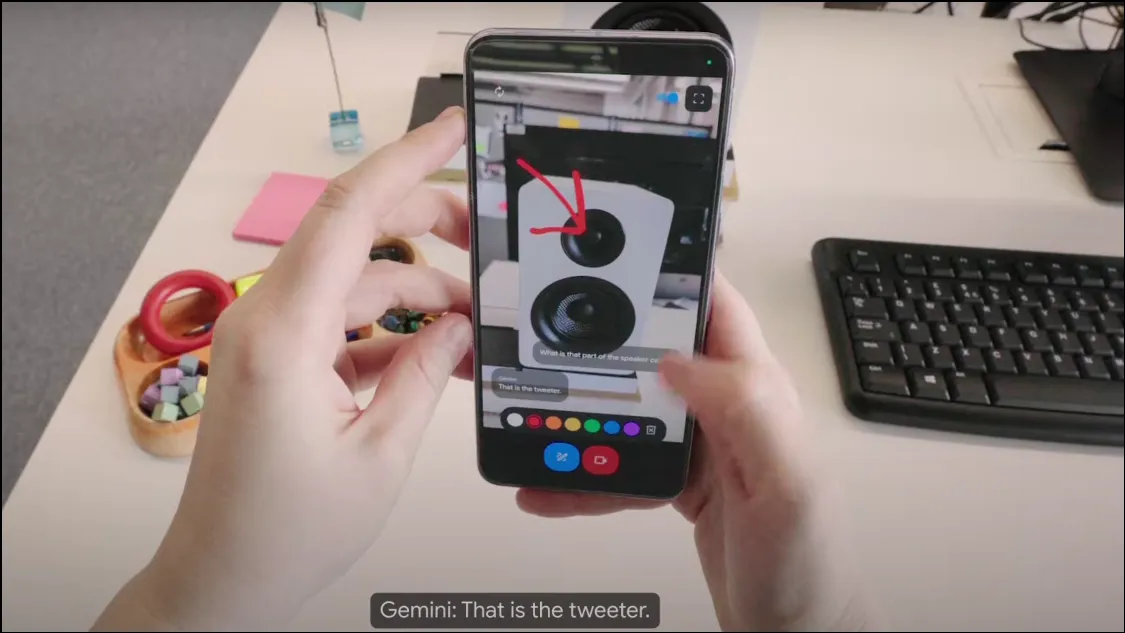

視覚機能

スマートフォンのカメラを使用すると、Gemini Live はリアルタイムでビデオを撮影できます。これにより、オブジェクトを識別し、それに関する質問に答えることができます。たとえば、スマートフォンのカメラをスピーカーに向け、Gemini に識別するように依頼すると、それが何であるかを教えてくれ、メーカーやモデルも識別します。

Gemini Live はどのように動作しますか?

Project Astra は音声と視覚的な入力を組み合わせて、AI モデルが理解しやすいようにすることができます。その後、情報に反応して必要な支援を提供できます。OpenAI の GPT-4o 搭載 ChatGPT と同様に、Gemini Live はマルチモーダル AI であり、入力としてテキストのみに依存しません。

Gemini Live は、最初のリリースでは音声入力を使用してデータを収集および分析しますが、今後数か月以内にアップグレードされ、ビデオをフレームごとに分解して処理および分析し、理解と対話性を向上させる予定です。

AI はさまざまなユーザーの話すスピードに適応でき、説明を求めたり、さらに情報を提供したりするために AI を中断することもできます。人間の会話を模倣する能力により、より魅力的なやり取りが可能になります。そのため、人間のアシスタントと同じように、AI と会話を交わすことができます。さらに、AI の音声は 10 種類から選択できます。

GPT-4o 対 Gemini Live

GPT-4o と Gemini Live はどちらもマルチモーダル AI モデルですが、現時点ではどちらも公開されていないため、どちらが実際の使用でより優れたパフォーマンスを発揮するかを判断するのは困難です。

しかし、ChatGPTとは異なり、Gemini Liveは、動画や画像の形式で出力を提供するために、Google VeoやImagen 3などの他のAIモデルに依存しています。それにもかかわらず、OpenAIとGoogleが披露したデモでは、ChatGPTの方が自然に見え、新しいGPT-4oモデルは声のトーンを通じて人間の感情を検出してシミュレートすることさえできました。

さらに、ユーザーが望む回答方法に適応できますが、少なくとも現在の Gemini Live ではそれができません。

ジェミニライブの可用性

Gemini Live は、AI チャットボットの有料版である Gemini Advanced 加入者向けに提供されます。今後数か月以内に展開され、年末までに広く利用可能になる予定です。

Google メッセージなどのアプリは Gemini Live を最大限に活用できるようになり、ユーザーはメッセージング アプリ内で AI と直接やり取りできるようになります。

Gemini Live は、Google の AI チャットボットの次のメジャー アップグレードになる可能性があり、OpenAI の ChatGPT などのライバルに対抗するために必要なものとなるでしょう。マルチモーダル機能と強力な音声機能を備えたこのアップグレード モデルは、Google が多用途で信頼性の高いデジタル アシスタントの提供に成功するのに役立ちます。

現時点では、Google は新しい AI モデルを有料会員に提供するとしか発表していません。Google のユーザー ベースの大部分を占める無料ユーザーは対象外ですが、Google が姿勢を変えて Gemini Live の利用範囲を拡大する決断を下すことを期待しています。

コメントを残す