AppleはWWDC 2024で、iPhone、iPad、Mac、VisionProのOSアップデートを含む、自社デバイスの新機能やアップデートを多数発表した。さらに、Apple Intelligenceと名付けた独自のAIも発表し、まもなくすべてのAppleデバイスに搭載される予定だ。

しかし、最も重要な発表の 1 つは、Apple の仮想アシスタントである Siri が大幅にアップグレードされるという点です。新しい、より直感的なデザイン、会話機能の改善、OpenAI の ChatGPT との統合が特徴となります。

このアップグレードは、Apple の iPhone 向け新 OS、iOS 18 の一部として提供され、Siri がより多くのことをより優れた方法で実行できるようになります。これはメジャー アップグレードなので、議論すべき点がたくさんあります。それでは、Siri の新機能を見てみましょう。

新しいデザイン

Siri の新機能や改善された機能については語るべきことがたくさんあるが、すぐに注目を集めたのはその再設計だった。このバーチャル アシスタントはデザインが全面的に見直され、起動するたびに、以前表示されていたシンボルの代わりに、デバイスの端に沿って光るライトが表示されるようになる。

Siriはどこでも使えるようになりました

Apple が Apple Intelligence と呼んでいる生成 AI は、Apple デバイスに導入され、Siri にも搭載される予定です。これにより、Siri はアプリの内外両方で動作できるようになり、システム全体で起動することもできます。

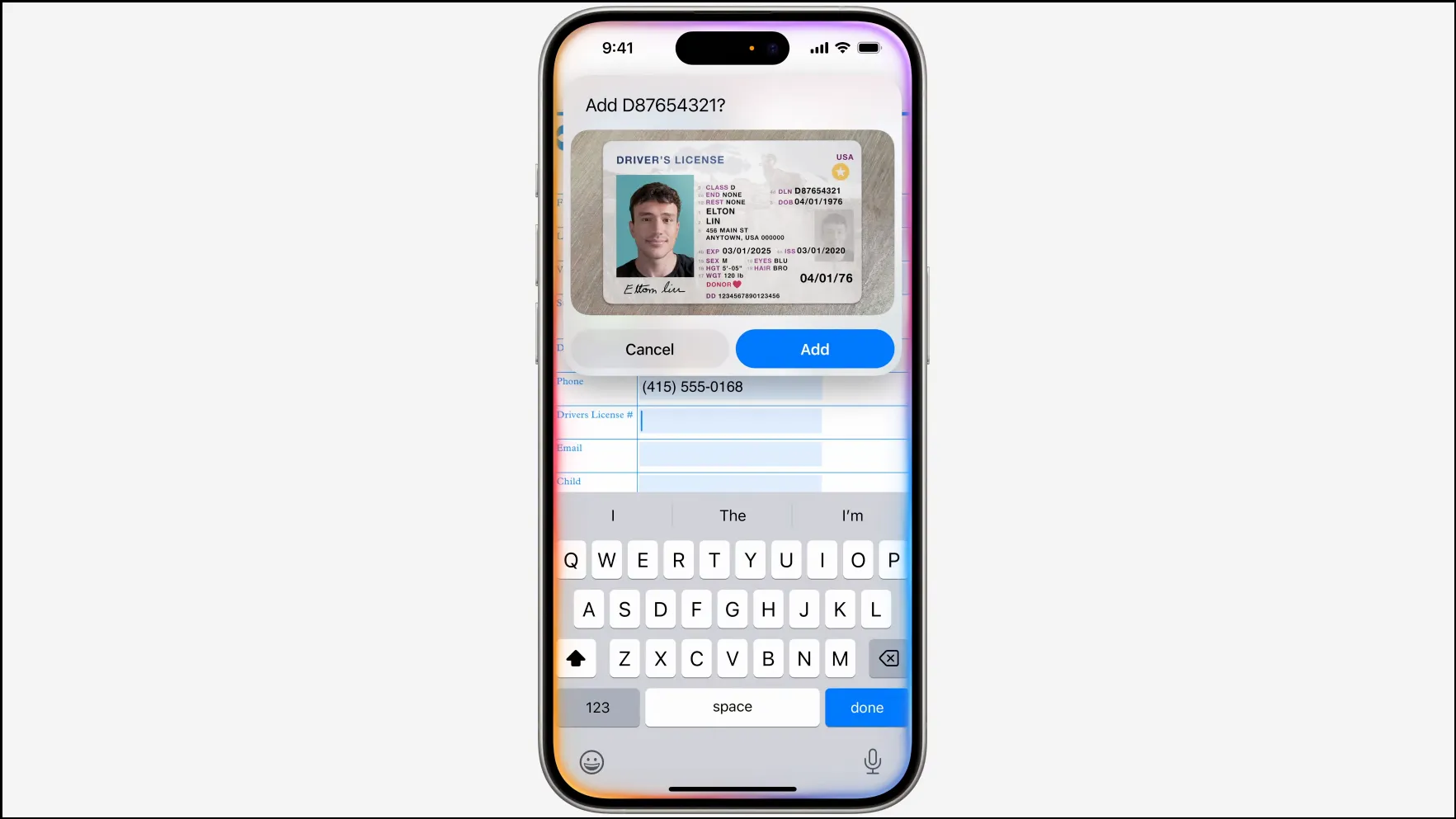

運転免許証や電子メールなどの文書から情報を取得し、それを抽出してフォームに記入するなどのアクションを実行できます。

オンスクリーン認識

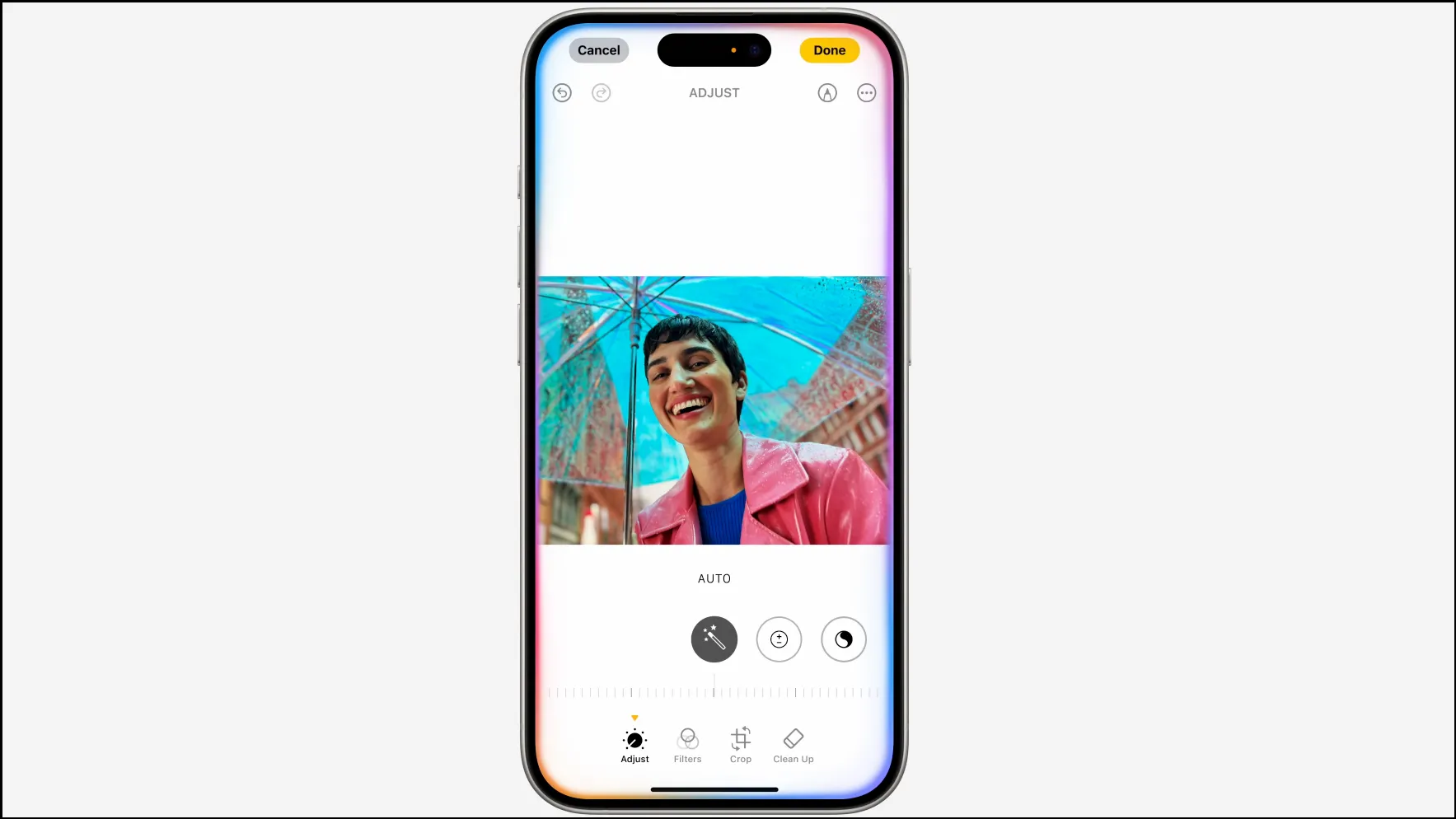

Siri には「オンスクリーン認識」と呼ばれる新機能も追加され、携帯電話の画面上で何が起こっているかを理解し、必要に応じてユーザーに代わってアクションを実行できるようになります。

たとえば、 のようなプロンプトを使用するShow me pictures of [your friend] in a pink outfitと、それらが表示されます。

同様に、写真を選択して Siri に尋ねると、Make this photo pop簡単に実行できます。

Siri が写真を編集したら、もう一度「」などのコマンドを入力するAdd this photo to Notesと、Siri が再びそのアプリを開いて必要なアクションを実行します。Apple によると、Siri はさまざまなアプリ内やアプリ間で複数のアクションを実行できるようになります。

これらのアクションは、Apple の新しい App Intents フレームワークに依存しており、開発者向けに API としても提供される予定です。そのため、開発者はサードパーティ製アプリを設計して、その中で Siri が動作するようにすることができます。

テキストインタラクションをサポート

Siri のアップグレードには、長らく待望されていた機能や、他の同様のチャットボットに以前から搭載されていた機能も含まれています。その中で最も重要なのは、テキストを使用して Siri と対話できることです。ユーザーは、下部をダブルタップしてチャットボットを起動し、必要に応じて質問やコマンドを入力することで、この機能を利用できるようになりました。

Siriと対話するために文字入力できるようになりました。ビデオソース: Apple

これにより、他の人に迷惑をかけたくない場合や、検索内容をよりプライベートに保ちたい場合に、Siri がさらに使いやすくなります。

会話機能の向上

Siri は会話を理解する能力も向上しており、ユーザーは仮想アシスタントとのやり取りがより自然になります。新しい機能のおかげで、たとえ声に出して話すときにつっかえつっかえしても、Siri はユーザーの指示や質問を理解できるようになりました。そのため、以前のように質問やリクエストを繰り返す必要がなくなるかもしれません。

たとえば、what's the weather like特定の場所で Siri に質問したが、その場所の名前を間違って発音した場合でも、仮想アシスタントはユーザーの意図を理解し、関連する情報を表示することができます。

もう 1 つの改善点は、Siri がリクエスト間の会話のコンテキストを保持できるようになったため、一度にさまざまな操作を要求できるようになったことです。

たとえば、Siri に特定の場所の天気について尋ねた後、その場所へのハイキング旅行などのイベントを作成するようにチャットボットに依頼できます。Siri は自動的にあなたの要望を理解するので、場所の名前をもう一度言う必要はありません。

個人のコンテキスト認識

さらに、セマンティック インデックスにより、Siri はカレンダー、ファイル、写真などのアプリ内の個人データにアクセスし、PDF ドキュメントなどの必要な情報を提供できるようになります。探しているものが何なのかわからない場合でも、情報を見つけることができるようになります。

たとえば、友達があなたに本を勧めてくれたことは覚えているが、メールかメッセージで送ってきたかどうかは覚えていないとします。そこで、 のようなリクエストを使うShow me the book recommendations [your friend] sent earlierと、Siri が関連情報を独自に見つけることができます。

また、Siri に頼めばGet my ID from my driver's license、そのリクエストを満たすためにデータを検索し、フォームに追加することもできます。

Siri に他のコマンドを与えると、それに応じて Siri はさまざまなアプリを切り替えて、探している情報を提供します。このすべては、ユーザーのプライバシーを完全に確保しながら行われます。ほとんどのプロセスはデバイス上で実行され、残りは Apple シリコン上で実行される Apple の新しいプライベート クラウド コンピューティング専用サーバーに依存します。

Siriにデバイスサポートが登場

Siri は、Apple デバイスの機能や設定に関する幅広い製品知識も備えています。そのため、iPhone、iPad、Mac について質問すると、どこにいてもデバイスのサポートが提供され、デバイスについて学ぶのにも役立ちます。Apple デバイスの操作方法を簡単に学ぶことができます。正確な名前がわからなくても、説明だけをすれば、Siri はどの機能について言及しているのか理解できます。

たとえば、Siri に尋ねるHow do I send a message so it gets delivered tomorrow?と、仮想アシスタントは、「後で送信」機能の指示を具体的に要求していなくても、そのタスクを実行するために必要なすべての手順を提供します。

ChatGPT統合

OpenAI は最近、最新の GPT-4o フラッグシップ モデルを公開しました。Apple は同社と提携して、その機能を Siri に導入します。このアシスタントは ChatGPT と統合され、いつでも好きなときに質問したり提案を受けたりできるようになります。

Siri に、自分では答えられないような複雑な質問をすると、リクエストを完了するために ChatGPT を使用するかどうかを尋ねられます。使用すると、Siri は ChatGPT の機能を活用して必要な情報を提供します。Apple は、ユーザーのリクエストと情報は保持されず、Siri 経由で使用するために ChatGPT アカウントも必要ないと述べています。

Siriは、Apple IntelligenceとChatGPTの統合により、ここ数年で最も重要なアップグレードを受けており、再び実際に役立つものに近づいています。残念ながら、アップグレードされたバージョンは、iPhone 15 Pro、iPhone 15 Pro Max、およびM1以降のチップを搭載したiPadとMacなど、いくつかの特定のデバイスでのみ利用できるようです。

新しくアップグレードされた Siri がいつ利用可能になるかについては、Apple は今年の秋にリリースすると述べている。つまり、サポートされていないデバイスを使用しているユーザーには、Siri の新機能にアクセスするために新しいデバイスにアップグレードするかどうかを決める十分な時間が与えられることになる。

コメントを残す