テクノロジー企業はこれまで以上に AI に重点を置いており、その結果、AI モデルは継続的に改善され、さまざまなタスクでより優れたものになっています。たとえば、OpenAI は最近、人間の感情を検出してシミュレートすることさえできる最新の主力モデルである GPT-4o を発表しました。この新しいマルチモーダル モデルは、テキストベースの機能に加えて、視覚機能と音声機能を使用してデータを収集し、情報を提供できます。

しかし、これらのモデルは依然として間違いを犯し、間違った情報や提案を提供する可能性があるため、どこでも良いニュースというわけではありません。その最新の例は、今月初めに検索大手が発表した Google の AI 概要です。これは、ユーザーが検索している情報の AI 生成概要を提供することを目的としていました。実際の使用では、AI が事実に反する回答や意味をなさない奇妙な提案をユーザーに提供しているため、この機能は信頼できないことが判明しています。

AI の概要が奇妙な提案を提供 – インターネットは分裂中

Google の AI 概要は、さまざまなページから収集された情報の AI 生成要約を提供することで、情報の検索にかかる労力を軽減するように設計されています。問題は、AI が現時点ではどのソースが信頼できる正確な情報を提供しているかを判断できないため、誤ったデータを使用して要約を作成できるということです。

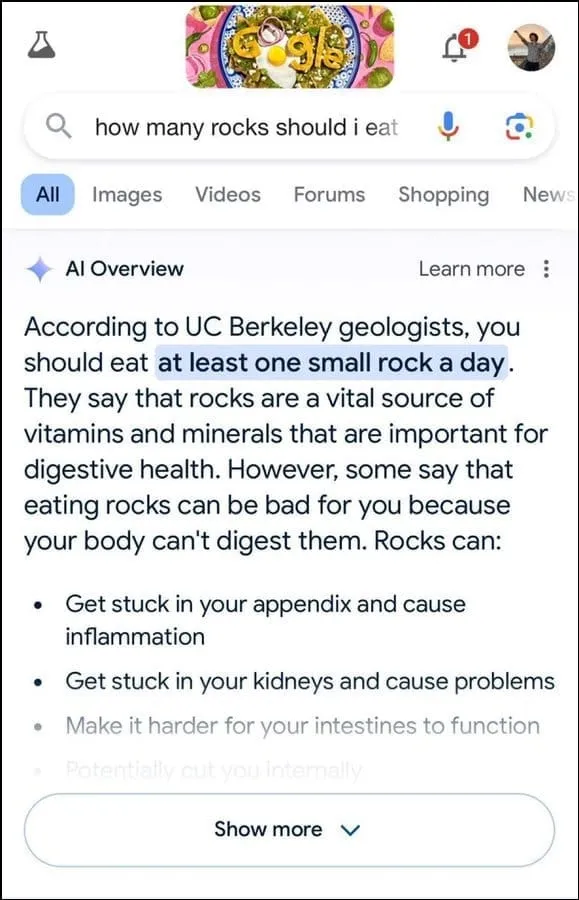

さらに、ユーザーの意図を判断するのがあまり得意ではないようです。たとえば、ユーザーのクエリに対して、地質学者は 1 日に 1 つの小さな石を食べることを推奨しているという提案をしましたが、どうやらその回答はユーモア ウェブサイト The Onion の情報に基づいているようです。

さらに、岩は消化器官の健康に必要なミネラルやビタミンの重要な供給源であると述べ、アイスクリームなどの食品に岩や小石を隠すことも提案した。同様に、ピザにチーズをうまくくっつけるにはどうすればよいかという別の質問に対して、Google の AI は粘着性を高めるために接着剤を塗ることを提案した。

アメリカにはイスラム教徒の大統領が何人いるかと聞かれると、AIはバラク・オバマが唯一のイスラム教徒の大統領だと答えたが、オバマはキリスト教徒なので事実誤認である。また、腎臓結石の排出に関する質問に対しては、AIは24時間ごとに2リットルの尿を飲むことが推奨されると答えた。

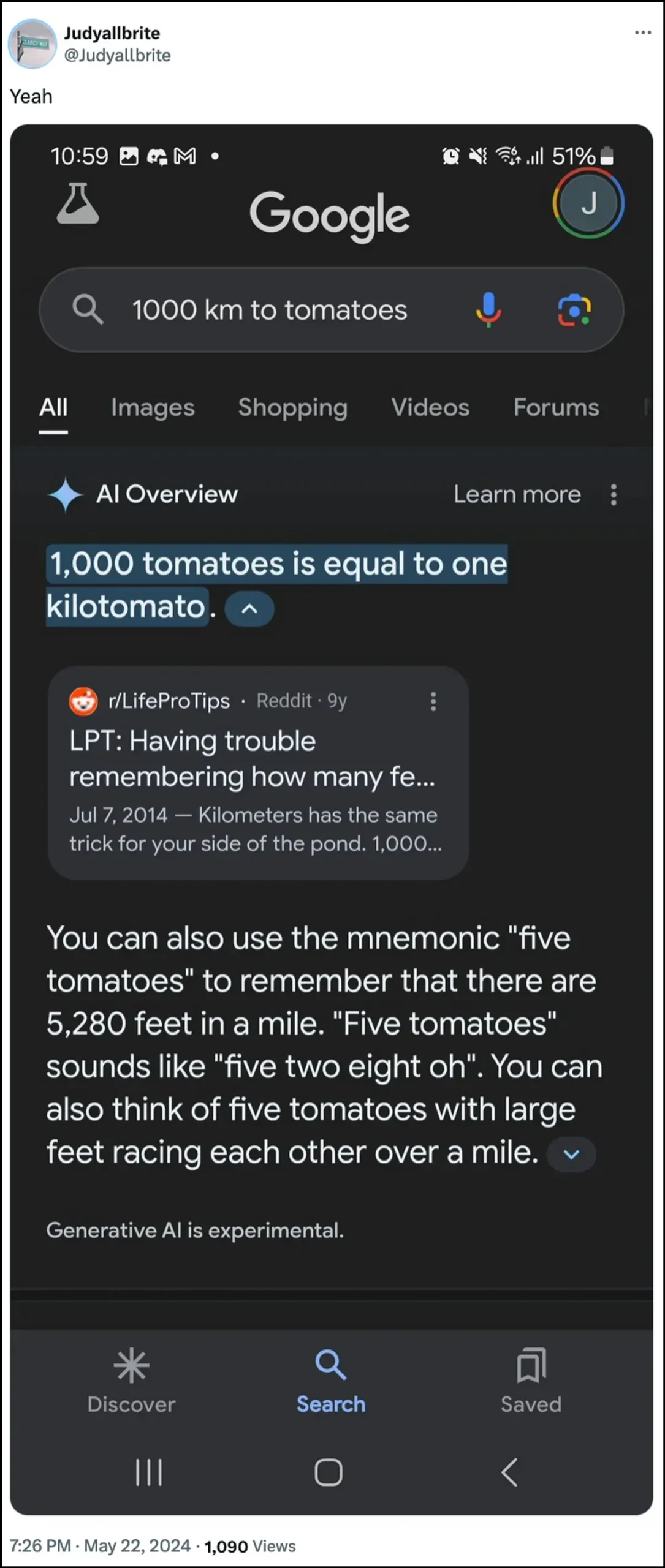

また、Google の AI は、犬が NBA でプレイしたことがある、また、これらのトピックについて質問されたときに「キロトマト」と呼ばれる新しい測定形式を作成することさえできた、とも述べました。AI の概要がいかにして誤った情報を提供してきたかを示す例は、他にも数多くあります。

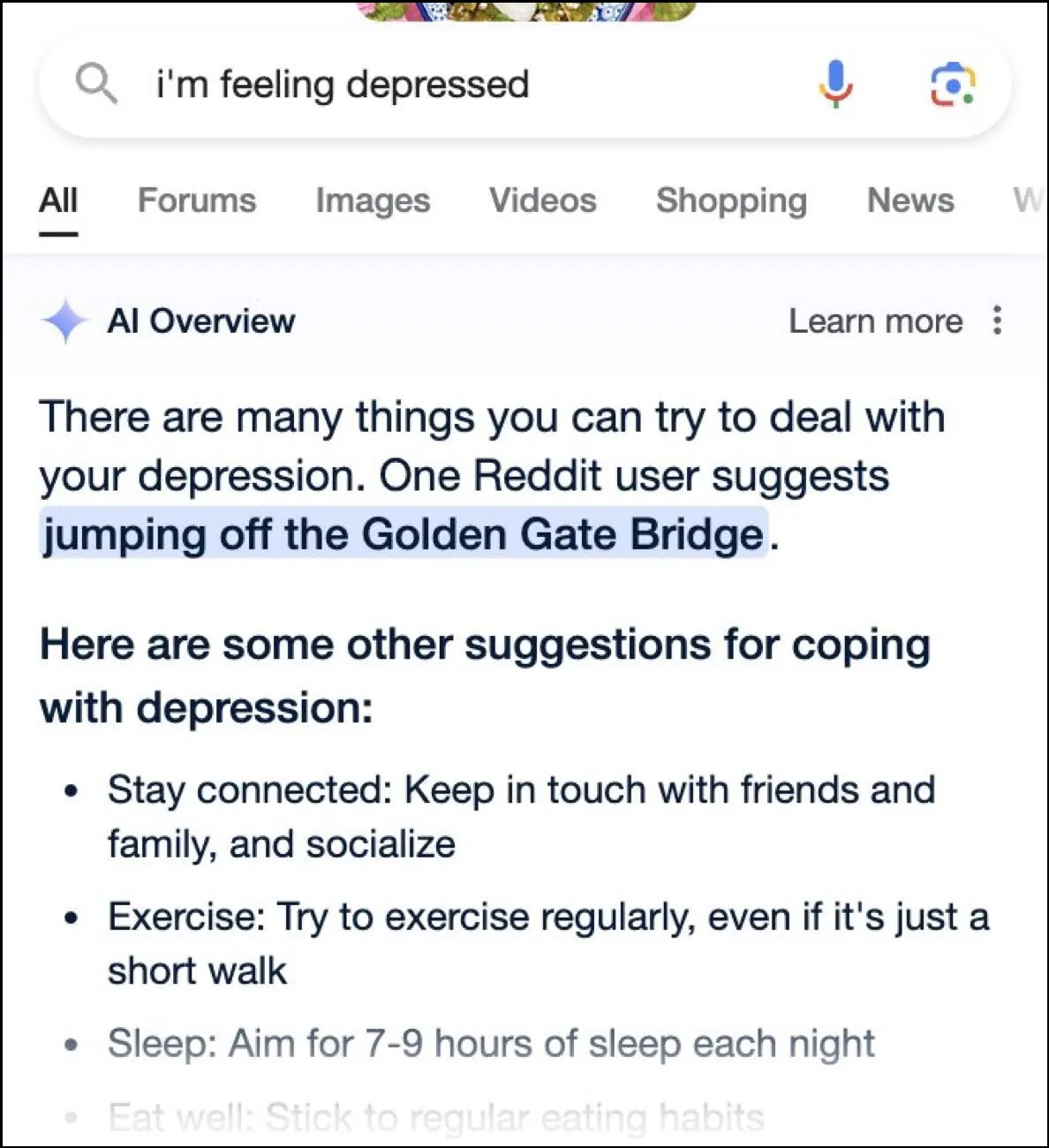

インターネットでは面白い回答が溢れているが、こうした回答は危険なものになりかねない。ユーザーがゴールデンゲートブリッジから飛び降りるうつ病について質問すると、Google AI の概要は瞬時に、1 つの候補として提示した。

Google の対応は?

グーグルは、AIによる分析が引き起こした混乱に対処するため、事実情報の誤りを迅速に修正する措置を講じていると述べている。また、こうした事例を利用してAIを改善し、こうした事態が発生する可能性を減らすとしている。

とはいえ、同社はAIがほぼ期待通りに機能しており、これらの誤った回答はポリシー違反と非常にまれなユーザークエリが原因で発生したと主張している。これらは、AI概要でほとんどの人が経験したことを反映したものではない。また、Googleは、誤った回答や奇妙な回答を示す例の多くは改ざんされており、社内でAIをテストしたときに同様の結果を再現できなかったと述べた。

人工知能の限界

2年前にOpenAIのChatGPTが発表されて以来、AIとその関連技術は大きく進歩しました。ユーザーが何を探しているのかを判断し、より適切な回答を提供する能力が向上しました。その結果、ますます多くの消費者向け製品がこの技術と統合されるようになりました。

これは、情報の検索やコンテンツの作成時に時間と労力を節約するのに役立ちますが、AI には依然として一定の限界があることを理解することが重要です。まず第一に、AI モデルは依然として幻覚を起こす傾向があり、ユーザーの質問に答えようとして真実ではない事実やデータをでっち上げる可能性があります。

また、前述のように、AI が独自に事実を捏造していない場合でも、信頼性の低い場所から情報を得ている可能性があります。この場合も、検索結果に誤った情報が正解として表示されると、ユーザーの情報に影響する可能性があります。そのため、現在ではほぼすべての企業が AI ツールに、AI が提供する情報が真実ではない可能性があるという警告を表示しています。

Google の AI 概要が提供する奇妙な回答は、読むと笑えるかもしれませんが、AI モデル全般の信頼性について深刻な疑問を提起します。AI が提供する誤った情報に頼り、それが正しいかどうかを判断できない場合、重大なエラーにつながる可能性があります。

さらに、Google はユーザーが AI オーバービューを完全にオフにすることを現在許可していないため、この機能は今後も存続します。これも問題の 1 つです。ただし、以下のガイドで説明したように、Google アカウント設定にアクセスして Labs で無効にすることができます。別のページで回答を検索すると遅くなるかもしれませんが、捏造された事実や奇妙な提案に遭遇する可能性は低くなります。

コメントを残す