Apple は、Visual Intelligence と呼ばれる新しい AI 機能を導入しました。これは、近々リリースされる iOS 18.2 アップデートでリリースされる予定です。最新のベータ版を実際に使用してみると、さまざまな魅力的な機能が明らかになりました。Visual Intelligence は、カメラを Google Lens に似た、洗練された AI 駆動型ツールに変えます。

ビジュアルインテリジェンスとは正確には何でしょうか?

Siri はユーザーの問い合わせに応答する音声対話型 AI として機能しますが、Visual Intelligence は視覚中心の AI として機能し、さまざまなアイテムにカメラを向けて情報を収集したり、簡単なタスクを実行したりできるようにします。

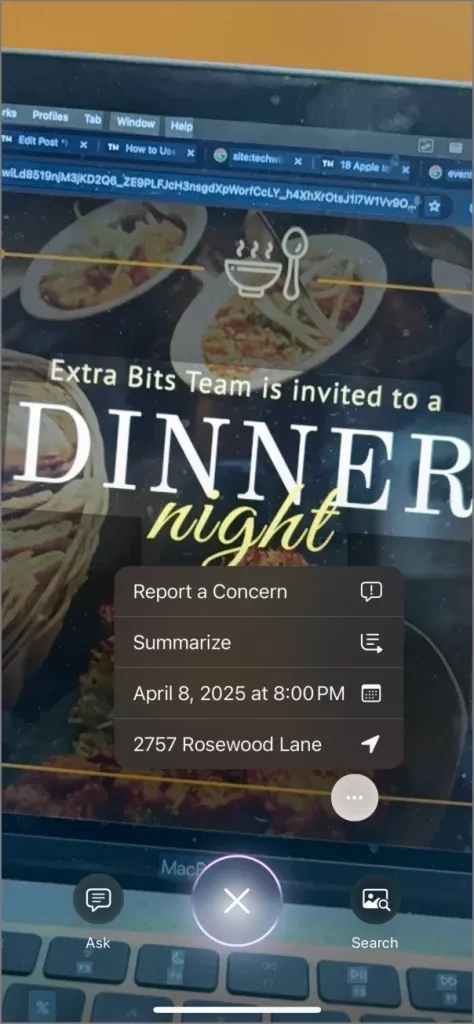

たとえば、iPhone をレストランに向けると、Apple マップから直接取得した評価や営業時間が表示され、メニューも表示されることがあります。イベントのチラシをスキャンすると、イベントをカレンダーに追加したり、会場までの道順を取得したりするためのオプションが自動的に表示されるので、手動でデータを入力する必要がありません。

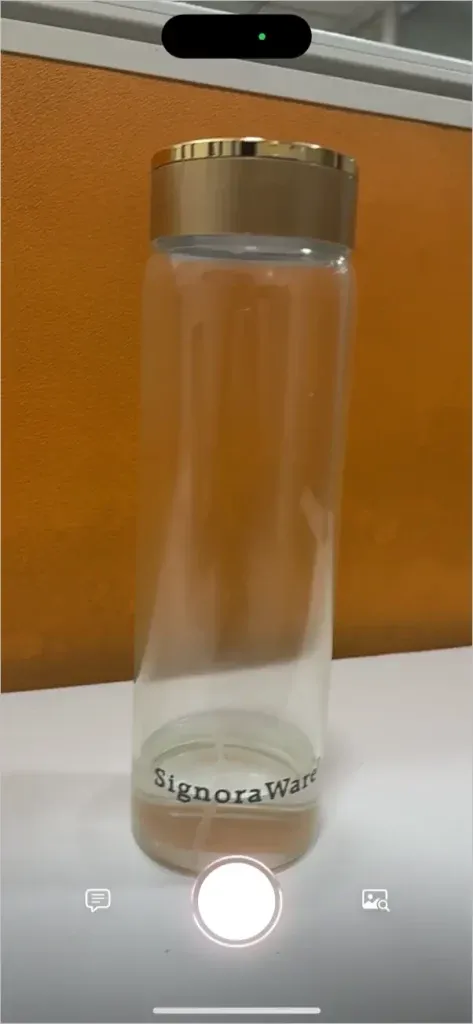

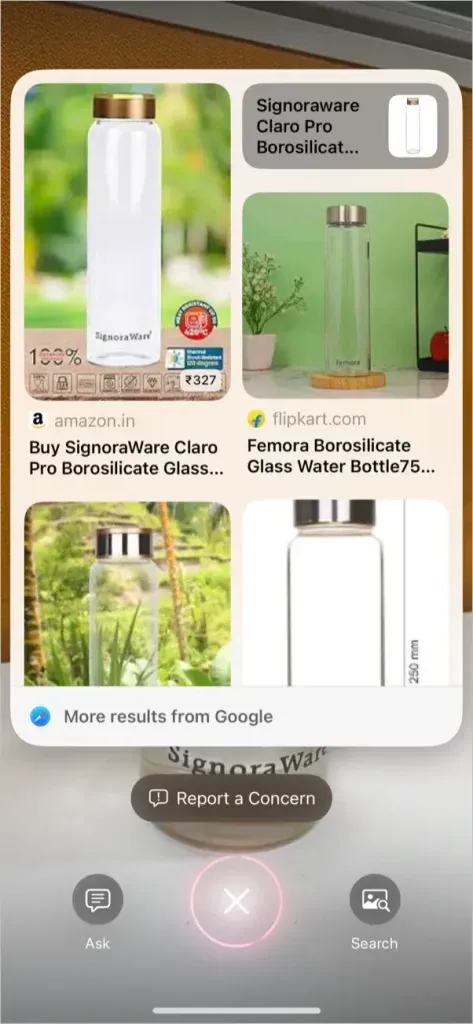

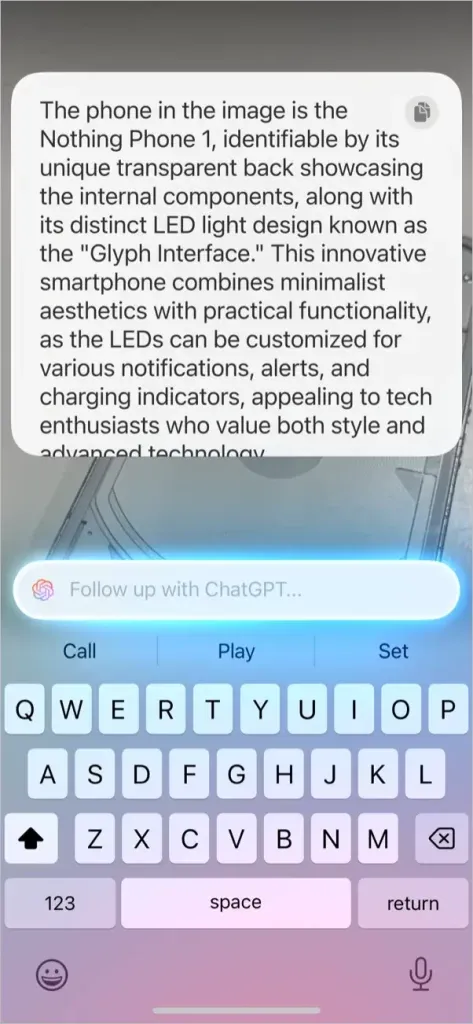

カメラを任意のアイテムに向けるだけで、ChatGPT を使用して情報を取得したり、Google で類似の画像を検索したりできます。つまり、動物や植物の種類を特定したり、オンラインで製品を購入できる場所を見つけたりすることもできます。

Visual Intelligence は、Apple 独自の機能強化が施された Google Lens の高度に統合されたバージョンであると考えてください。ただし、この機能は A18 チップの機能を利用する iPhone 16 シリーズに限定されています。

視覚的知能を活性化する方法

iPhone 16 のカメラコントロール機能を通じて、Visual Intelligence にシームレスにアクセスできます。これは iOS 18.2 アップデートの一部で、現在は最初の開発者ベータ版であり、年末までに一般公開される予定です。開始するには、iOS 18.2 アップデートのベータ チャネルに切り替えるか、安定版のリリースを待ってください。

- 新しいカメラ コントロールボタンを長押しすると、プレビューとキャプチャ オプションを備えたカメラのビューファインダーに似たインターフェイスが表示されます。

- 起動したら、情報を取得したいオブジェクトにカメラを向け、キャプチャ ボタンを押してVisual Intelligence を起動します。

- 主題が何であっても、常に「質問する」と「検索する」という 2 つの選択肢が表示されます。

- 質問する:会話に参加して詳細を知るために、画像をChatGPTに送信します。

- 検索: Google を使用して、類似の画像や関連商品をオンラインで購入するためのリンクを検索します。

日常生活でビジュアルインテリジェンスを活用する

- iPhone をランドマークに向けると、その名前、歴史的背景、訪問時間、近くの施設などが表示されます。

- iPhone のカメラを本の表紙や商品にかざし、検索機能を使用してレビューや購入オプションなどを検索します。

- 携帯電話を植物や動物に向け、質問機能や検索機能を活用して種を識別し、さらに生息地、種の特徴、世話の提案などの追加の情報も得ることができます。

- イベントのポスターにカメラを向けると、Visual Intelligence がイベント名、時間、日付、場所を抽出し、カレンダーに直接追加するオプションも用意されています。

- 長いテキストに遭遇した場合は、カメラをそのテキストに合わせるだけで簡単な要約が表示されるほか、ChatGPT が簡単な言葉で説明してくれます。

Visual Intelligence は非常に便利なツールですが、いくつかの制限もあります。たとえば、Google Lens とは異なり、大きな被写体をライブ検索できるビデオ録画オプションが現在ありません。将来のアップデートでこの機能が修正されることを期待します。

チェックすべき iOS 18 の隠れた機能 31 選

コメントを残す